您现在的位置是:主页 > 科技圈快讯 > 人物 >

马斯克投资290亿,购置10万台H100打造顶级AI超算系统

发布时间:2024年07月23日 17:36:27 人物 人已围观

简介马斯克在推特上宣布,他联合xAI、X和英伟达打造的孟菲斯超级集群正式投入训练。该集群由10万块H100组成,标志着全球最强AI集群的建成。这一消息让科技界备受关注,彰显了人工智能...

全球最强AI集群,马斯克终于建设完成!

这个震撼消息是由马斯克本人通过推特正式公布的。

在当地时间凌晨4:20,由xAI、X和英伟达等多方共同开发的孟菲斯超级集群已正式开始训练。

该集群由10万块H100组成,成为当前全球最强大的训练集群!

这个规模已大幅超越全球最强超级计算机Frontier。

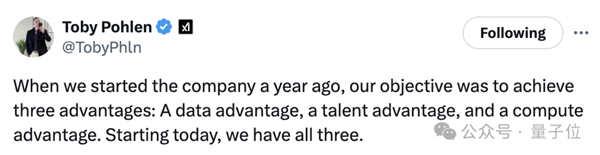

xAI的创始团队随后表示:

在我们一年前成立这家公司时,设定了三大目标:数据、人才和计算的优势。

从今天起,这三大优势我们都具备了!

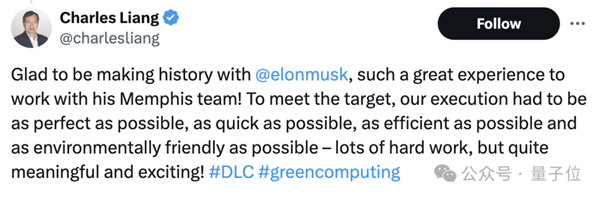

在马斯克的推文下,与英伟达保持紧密关系并专注于液冷技术的超微(Supermicro)也送上了祝贺。创始人查尔斯·梁表示:

非常高兴能够与马斯克一起书写历史。

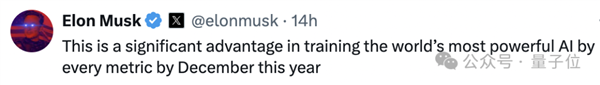

同时,马斯克补充说,该集群的完工,极大提升了今年内训练出全球顶尖模型的可能性。

根据先前的说法,训练Grok-3确实需要10万张H100。

△集群的俯瞰图

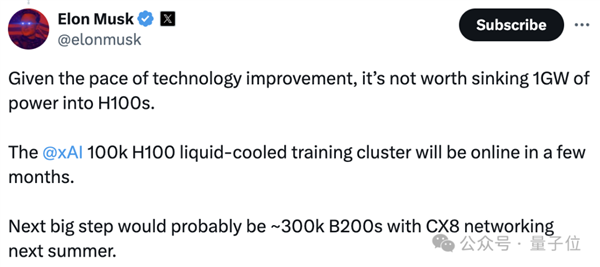

更有趣的是,今年6月,马斯克曾指出,为了H100投入1GW电力的做法是不理智的。预计明年夏天,可能会启动一个由30万块B200构成的新集群。

自主建设集群显得更可靠

根据The Information的消息,马斯克曾计划在2025年秋季之前建立一个由10万H100构成的超级计算集群,并与甲骨文展开合作。

有报道称,xAI计划投入100亿美元用于租赁甲骨文的服务器。

当时对此有人质疑,为什么明年建成却还是使用上代技术?

英伟达早已推出基于Blackwell新架构的B100和B200,训练大型模型的效率明显优于H100。

如今看来,或许消息中的时间存在不准确?如果今年完成确实合理得多。

最近,马斯克回应了与甲骨文终止合作建设超级计算集群的传闻。

他表示,xAI确实从甲骨文获取了24000块H100的资源来训练Grok-2。相关消息显示,xAI与甲骨文的服务器租用合作仍在进行中。

但在建设10万卡H100集群方面,选择了自建的方式,并快速推进,据说安装完毕所需的时间仅为19天。